Bahasa – Bahasa Baru Untuk Komputasi Kuantum – Twist adalah bahasa pemrograman yang dikembangkan MIT yang dapat menjelaskan dan memverifikasi bagian data mana yang terjerat untuk mencegah bug dalam program kuantum.

Kristal waktu. Gelombang mikro. berlian. Apa kesamaan dari ketiga hal yang berbeda ini?

komputasi kuantum. Tidak seperti komputer tradisional yang menggunakan bit, komputer kuantum menggunakan qubit untuk mengkodekan informasi sebagai nol atau satu, atau keduanya secara bersamaan. https://www.premium303.pro/

Digabungkan dengan campuran kekuatan dari fisika kuantum, mesin seukuran lemari es ini dapat memproses banyak informasi tetapi jauh dari sempurna. Sama seperti komputer biasa, kita perlu memiliki bahasa pemrograman yang tepat untuk menghitung dengan benar di komputer kuantum.

Pemrograman komputer kuantum membutuhkan kesadaran akan sesuatu yang disebut “keterjeratan,” pengganda komputasi untuk jenis qubit, yang diterjemahkan menjadi banyak daya. Ketika dua qubit terjerat, tindakan pada satu qubit dapat mengubah nilai yang lain, bahkan ketika mereka terpisah secara fisik, sehingga memunculkan karakterisasi Einstein tentang “aksi seram di kejauhan.”

Tapi potensi itu sama-sama merupakan sumber kelemahan. Saat memprogram, membuang satu qubit tanpa memperhatikan keterjeratannya dengan qubit lain dapat menghancurkan data yang disimpan di qubit lain, membahayakan kebenaran program.

Ilmuwan dari Ilmu Komputer dan Kecerdasan Buatan (CSAIL) MIT bertujuan untuk mengungkap dengan menciptakan bahasa pemrograman mereka sendiri untuk komputasi kuantum yang disebut Twist. Twist dapat menjelaskan dan memverifikasi potongan data mana yang terjerat dalam program kuantum, melalui bahasa yang dapat dipahami oleh programmer klasik.

Bahasa menggunakan konsep yang disebut kemurnian, yang memaksakan tidak adanya keterjeratan dan menghasilkan program yang lebih intuitif, dengan bug idealnya lebih sedikit. Misalnya, seorang programmer dapat menggunakan Twist untuk mengatakan bahwa data sementara yang dihasilkan sebagai sampah oleh suatu program tidak terkait dengan jawaban program, sehingga aman untuk dibuang.

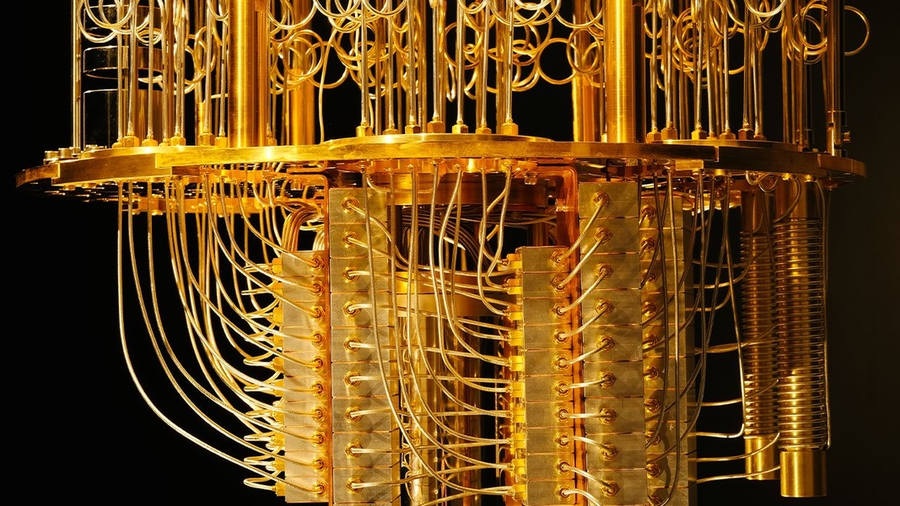

Sementara bidang yang baru lahir dapat terasa sedikit mencolok dan futuristik, dengan gambar mesin emas raksasa yang muncul di benak, komputer kuantum memiliki potensi terobosan komputasi dalam tugas-tugas klasik yang tidak dapat diselesaikan, seperti protokol kriptografi dan komunikasi, pencarian, dan fisika komputasi dan kimia.

Salah satu tantangan utama dalam ilmu komputasi adalah berurusan dengan kompleksitas masalah dan jumlah komputasi yang dibutuhkan. Sementara komputer digital klasik akan membutuhkan jumlah bit eksponensial yang sangat besar untuk dapat memproses simulasi semacam itu, komputer kuantum dapat melakukannya, secara potensial, menggunakan jumlah qubit yang sangat kecil jika ada program yang tepat.

“Bahasa kami Twist memungkinkan pengembang untuk menulis program kuantum yang lebih aman dengan secara eksplisit menyatakan kapan qubit tidak boleh terjerat dengan yang lain,” kata Charles Yuan, seorang mahasiswa PhD MIT di bidang teknik elektro dan ilmu komputer dan penulis utama pada makalah baru tentang Twist.

“Karena memahami program kuantum membutuhkan pemahaman keterjeratan, kami berharap Twist membuka jalan menuju bahasa yang membuat tantangan unik komputasi kuantum lebih mudah diakses oleh pemrogram.”

Yuan menulis makalah tersebut bersama Chris McNally, seorang mahasiswa PhD di bidang teknik elektro dan ilmu komputer yang berafiliasi dengan MIT Research Laboratory of Electronics, serta Asisten Profesor MIT Michael Carbin. Mereka mempresentasikan penelitian tersebut pada konferensi Simposium Prinsip Pemrograman 2022 minggu lalu di Philadelphia.

Mengurai keterikatan kuantum

Bayangkan sebuah kotak kayu yang memiliki seribu kabel yang menonjol keluar dari satu sisi. Anda dapat menarik semua kabel keluar dari kotak, atau mendorongnya sepenuhnya.

Setelah Anda melakukan ini beberapa saat, kabel membentuk pola bit nol dan satu tergantung pada apakah mereka masuk atau keluar. Kotak ini mewakili memori komputer klasik. Program untuk komputer ini adalah urutan instruksi kapan dan bagaimana cara menarik kabel.

Sekarang bayangkan kotak kedua yang tampak identik. Kali ini, Anda menarik kabel, dan melihat bahwa saat kabel itu muncul, beberapa kabel lain ditarik kembali ke dalam. Jelas, di dalam kotak, kabel ini entah bagaimana terjerat satu sama lain.

Kotak kedua adalah analogi untuk komputer kuantum, dan memahami arti program kuantum membutuhkan pemahaman tentang keterjeratan yang ada dalam datanya. Tetapi mendeteksi keterjeratan tidaklah mudah.

Anda tidak dapat melihat ke dalam kotak kayu, jadi yang terbaik yang dapat Anda lakukan adalah mencoba menarik kabel dan mempertimbangkan dengan cermat kabel mana yang terjerat. Dengan cara yang sama, pemrogram kuantum saat ini harus menalar tentang keterjeratan dengan tangan. Di sinilah desain Twist membantu memijat beberapa bagian yang saling bertautan.

Para ilmuwan merancang Twist agar cukup ekspresif untuk menulis program untuk algoritme kuantum terkenal dan mengidentifikasi bug dalam implementasinya. Untuk mengevaluasi desain Twist, mereka memodifikasi program untuk memperkenalkan beberapa jenis bug yang akan relatif halus untuk dideteksi oleh programmer manusia, dan menunjukkan bahwa Twist dapat secara otomatis mengidentifikasi bug dan menolak program.

Mereka juga mengukur seberapa baik kinerja program dalam praktik dalam hal runtime, yang memiliki overhead kurang dari 4 persen dibandingkan teknik pemrograman kuantum yang ada.

Bagi mereka yang waspada terhadap reputasi “kumuh” kuantum dalam potensinya untuk merusak sistem enkripsi, Yuan mengatakan masih belum diketahui sejauh mana komputer kuantum benar-benar dapat mencapai janji kinerja mereka dalam praktik.

“Ada banyak penelitian yang terjadi dalam kriptografi pasca-kuantum, yang ada karena bahkan komputasi kuantum tidak sepenuhnya kuat. Sejauh ini, ada serangkaian aplikasi yang sangat spesifik di mana orang telah mengembangkan algoritme dan teknik di mana komputer kuantum dapat mengungguli komputer klasik.”

Langkah penting berikutnya adalah menggunakan Twist untuk membuat bahasa pemrograman kuantum tingkat tinggi. Sebagian besar bahasa pemrograman kuantum saat ini masih menyerupai bahasa rakitan, menyatukan operasi tingkat rendah, tanpa perhatian terhadap hal-hal seperti tipe dan fungsi data, dan apa yang khas dalam rekayasa perangkat lunak klasik.

“Komputer kuantum rawan kesalahan dan sulit diprogram. Dengan memperkenalkan dan menalar tentang ‘kemurnian’ kode program, Twist mengambil langkah besar untuk membuat pemrograman kuantum lebih mudah dengan menjamin bahwa bit kuantum dalam potongan kode murni tidak dapat diubah oleh bit yang tidak ada dalam kode itu,”

kata Fred Chong, Profesor Ilmu Komputer Seymour Goodman di Universitas Chicago dan kepala ilmuwan di Super.tech.

Pekerjaan itu didukung, sebagian, oleh MIT-IBM Watson AI Lab, National Science Foundation, dan Office of Naval Research.